智元机器人今天宣布推出全球首个基于全域真实场景、全能硬件平台、全程质量把控的百万真机数据集开源项目 AgiBot World。这一项目标志着具身智能领域的“ImageNet 时刻”已经到来。

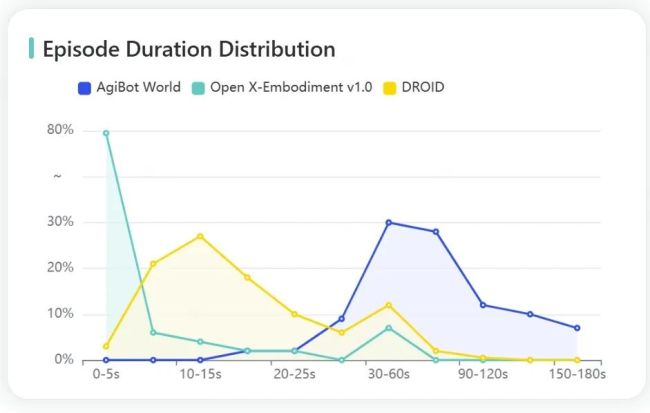

智元机器人将按计划在 HuggingFace、Github 以及 agibot-world.com 项目主页上分批上传数据。AgiBot World 是全球首个基于全域真实场景、全能硬件平台、全程质量把控的百万真机数据集。相比谷歌开源的 Open X-Embodiment 数据集,AgiBot World 的长程数据规模高出 10 倍,场景范围覆盖面扩大 100 倍,数据质量从实验室级上升到工业级标准。

未来,智元机器人将陆续开源千万仿真数据,以支持更泛化和更通用的大模型训练;发布具身基座大模型,支持模型微调;并发布全套工具链,实现采集、训练和评测闭环。

AgiBot World 数据集中涵盖的场景具备多样化和多元化特点,从抓取、放置、推、拉等基础操作,到搅拌、折叠、熨烫等复杂动作,几乎涵盖了人类日常生活所需的绝大多数场景。例如,其中一个视频展示了机器人在电脑主机中安装内存条的过程,这需要毫米级精细控制,稍有不慎就可能导致设备损坏。其末端触觉传感器帮助机器人实现了精准对接。另一个视频展示了机器人使用洗碗机,整理杂乱的餐具至相应卡槽中,操作流程长且动作繁琐。AgiBot World 数据集中收录了 80 多种日常生活中的多样化技能视频,让机器人能够掌握多种技能。

AgiBot World 数据集诞生于智元自建的大规模数据采集工厂与应用实验基地,空间总面积超过 4000 平方米,包含 3000 多种真实物品。该基地为机器人大规模数据训练提供场地,并真实复刻了家居、餐饮、工业、商超和办公五大核心场景,全面覆盖了机器人在生产、生活中的典型应用需求。家居场景再现人类真实住宅布局,包括卧室、客厅、厨房、卫生间等核心空间,可以实现家务清洁、物品整理和厨房任务等。工业场景模拟分拣与物流自动化,复刻工业仓库与生产线,包括分拣系统、打包设备、传输带等,可以实现物料分拣、包装打包、物流搬运等。通过多场景的高度还原与任务设计,AgiBot World 为机器人研发和测试构建了实现具身智能的必要条件。

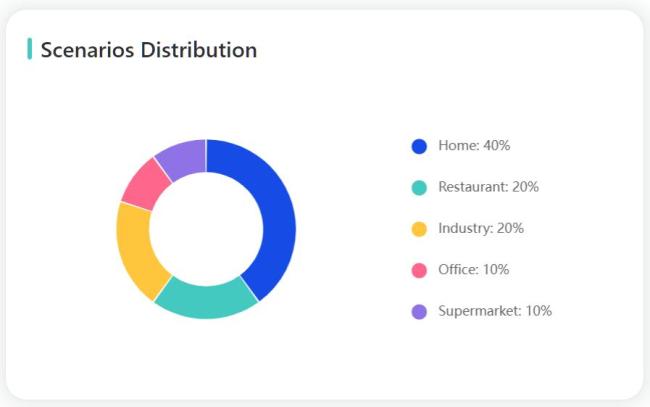

AgiBot World 百万真机数据集中有 100 多种类似的真实场景,家居占 40%、餐饮 20%、工业 20%、商超 10% 以及办公场景 10%,其中 80% 的任务均为长程任务,任务时长集中在 60s-150s 之间,并且包含多个原子技能,长程数据是 DROID 和 OpenX-Embodiment 的 10 倍以上。3000 多种物品基本涵盖了这五大场景,同时还在不断丰富中。

机器人能够如此灵活智能、胜任多种任务和技能,也得益于智元对机器人本体的迭代升级。机器人配备了 8 个环绕式布局的摄像头,可以实时 360 度全方位感知周围环境的动态变化;配备 6 自由度灵巧手,保障动作精准且灵活,同时末端还增加了六维力传感器和高精度触觉传感器,能够感知力的微小变化,做到“拿捏有度”;机器人全身拥有 32 个主动自由度,能够灵活应对多种复杂任务。

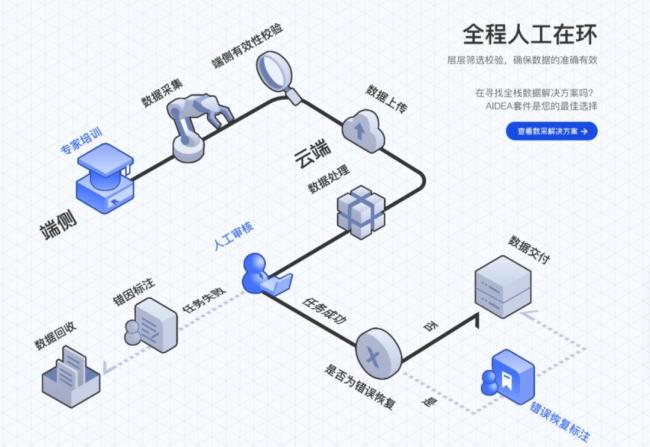

数据集的质量也是决定机器人能否快速学习的关键。AgiBot World 中的数据需历经一套严苛的流程与验证链路。在项目之初,学界、工业界、消费者等多方介入提出建议,不断迭代流程设计规划。数据采集质量环节,无论是采集员还是采集质量,均由完善的管理体系和专业的管理团队全程保障。对于采集到的数据本身,将通过端、云两侧严格筛选,自动剔除不符合要求的数据,再由专业的审核员逐帧审核,确保每一个动作都符合任务标准。这些数据还会通过算法进行二次验证,全方位筑牢数据质量防线。